安全不应该意味着审查:保留第230条并鼓励适度

如果一位客人在餐桌上发表了种族主义言论,你会责怪主人吗?如果主人保持沉默,没有阻止客人怎么办?如果主持人给这位嘉宾一个麦克风呢?这些都是最高法院通过两个案件来解决的问题挑战第230条,其中指出:

交互式计算机服务的提供者或用户不得被视为其他信息内容提供者所提供的任何信息的发布者或演讲者。

第230条保护平台和服务不对用户发布的内容承担责任。这意味着“聚会客人”要为他们的行为负责,而“主人”不用。最高法院的这些案件表明,谷歌和Twitter应该为它们推荐或托管的与恐怖主义有关的内容负责,这揭示了两个关键问题。社交媒体平台:

- 不要一直执行内容审核政策。大多数主要的社交媒体平台都有健壮的内容审核策略防止用户发布仇恨言论和虚假信息等内容。尽管有这些政策,但正如弗雷斯特的报告所记录的那样,一些内容仍然被遗漏了,在错误信息时代资助真相.Forrester数据2022年11月的一项调查发现,在已经停止或计划停止使用推特的美国网民中,近三分之一的人表示,他们觉得推特上的内容太可恶了,21%的人不喜欢传播的虚假信息太多。

- 向用户推荐有害内容。社交媒体算法就像麦克风一样,向每个用户推荐相关内容。当“相关内容”是危险的时,这种放大就会出现问题。一个14岁的英国女孩在Instagram上不断收到关于自残和自杀的视频和图片后自杀。当有害内容在平台上完好无损时而且算法有助于传播这些内容,这种结合是危险的。

集体在线体验将会退化

媒体行业不能忽视平台方面的这两个基本问题,但取消230条款并不能解决问题。我们所了解的互联网体验将会分崩离析,促进政府的高压干预和内容审查。大量的诉讼可能会迫使平台废除它们的算法,并在内容删除方面越权。废除这项法律将:

- 让内容不那么相关。虽然算法有时会推广有害内容,但它们也会为用户提供无害的、有趣的、有用的内容,为他们的体验增加价值。如果没有推荐引擎,内容就会变得不那么个性化,从而降低平台的价值。

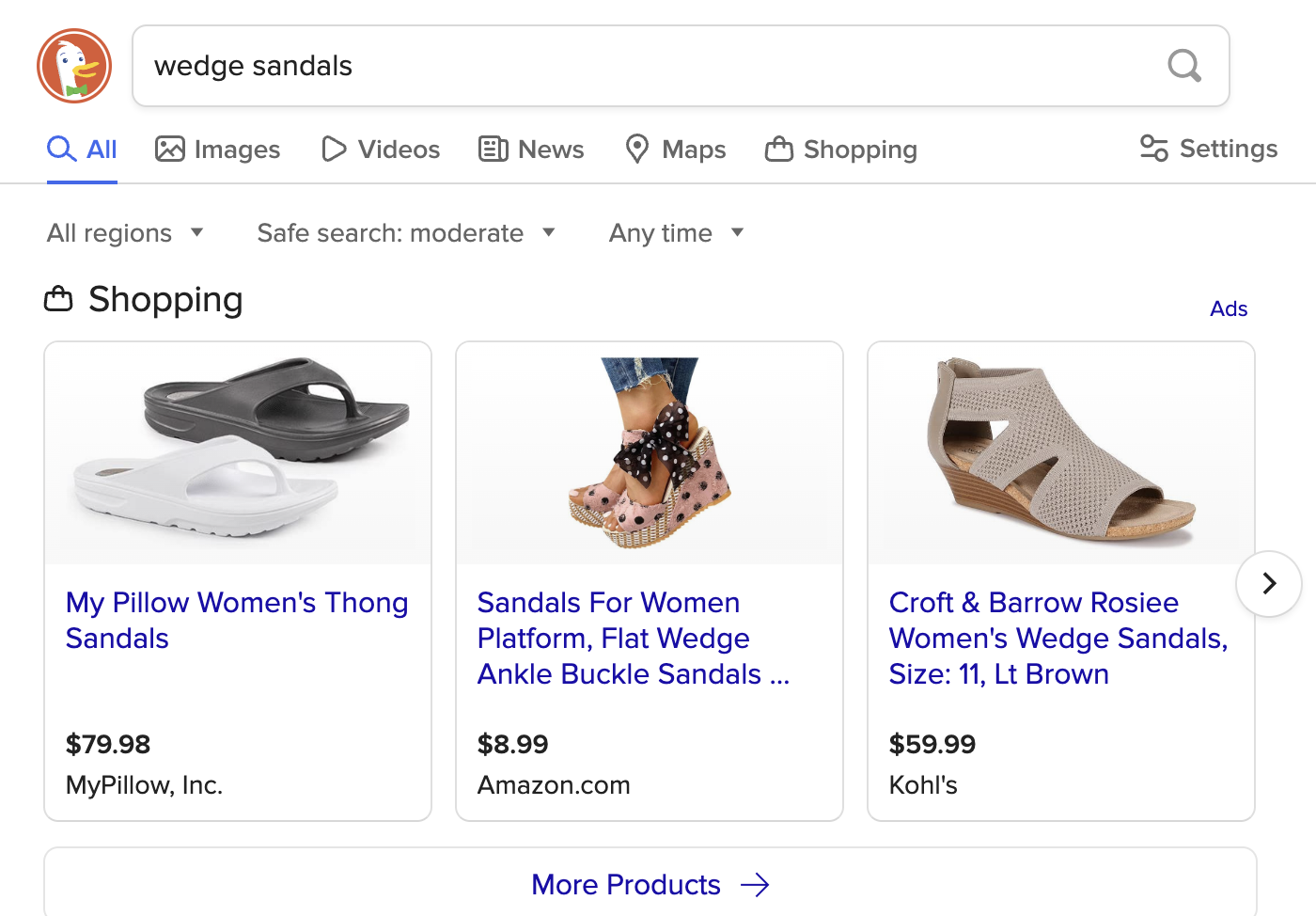

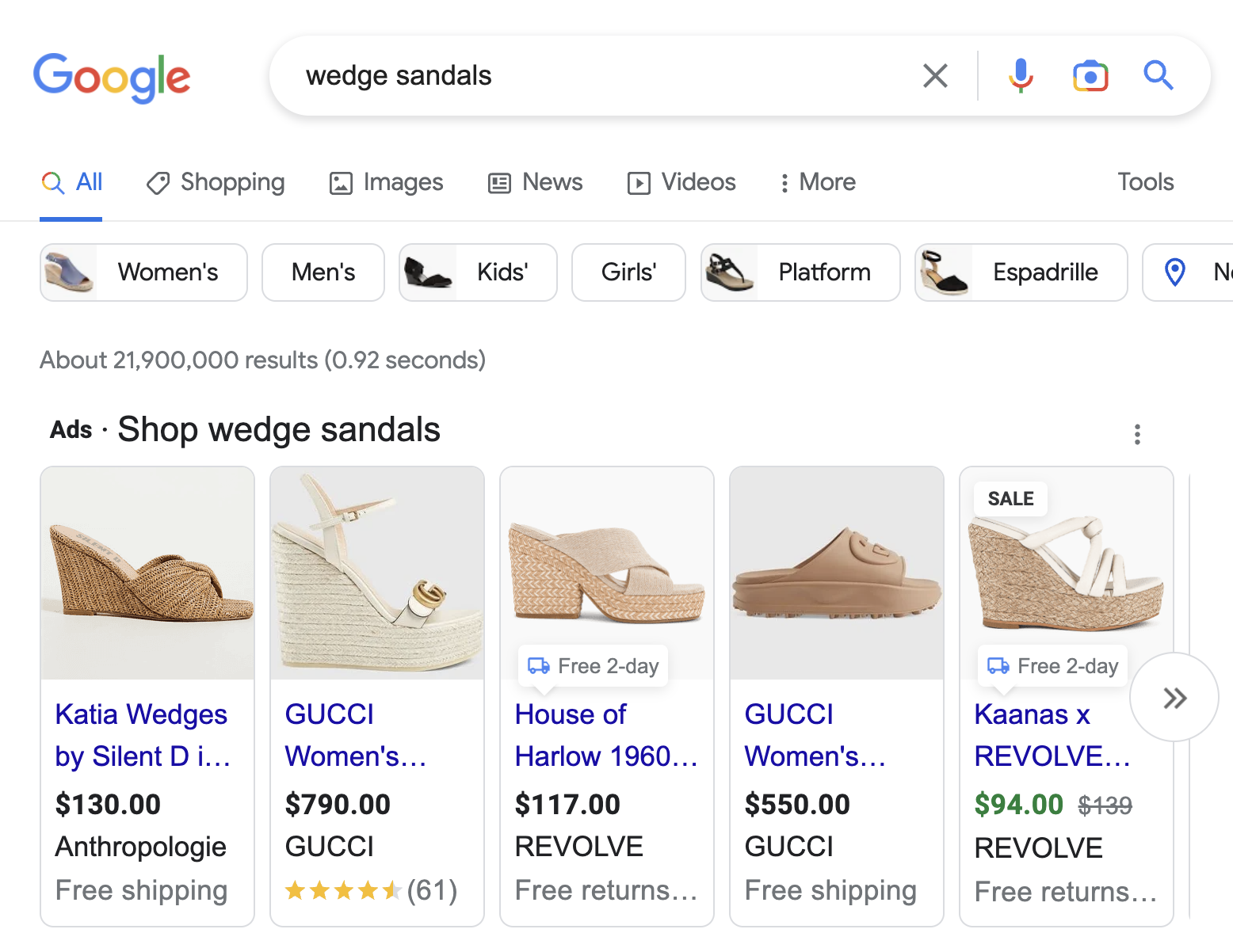

- 损害广告体验。个性化定位也能让广告更有效。DuckDuckGo是一个隐私优先的搜索引擎,只根据你搜索的关键字提供广告,没有其他个性化。搜索广告结果与谷歌有很大的不同(见图1)。谷歌为我提供了我知道和喜爱的品牌、风格和商店。它知道我的偏好,这使得广告更相关,更值得点击。

- 摧毁平台业务。广告是社交媒体平台收入的主要来源。如果广告不那么相关,用户就不会参与其中,品牌也不会看到同样的商业结果。广告商将把他们的资金转移到其他更有影响力的媒体渠道。

图1:谷歌上的搜索广告结果比DuckDuckGo更相关

策略实施解决核心问题

谷歌不希望恐怖主义内容出现在YouTube上,Meta也不希望传播虚假信息。这一点从他们的社区指导原则.核心问题不是推荐算法传播内容,而是有害内容仍然存在于系统中。平台必须开始执行自己的策略。营销人员必须给他们一些激励。利用你所拥有的杠杆(广告费用)来推动你的媒体合作伙伴改善体验。

福雷斯特的客户,要聊更多关于这个话题,您可以安排一个指导会议.